[XAI] LIME(Local Interpretable Model-agnostic Explanation) 알고리즘

blackbox 모델을 지역적으로 근사함으로써 설명 가능성을 제공하는 LIME 알고리즘에 대해 살펴봅니다.

myeonghak.github.io

https://www.youtube.com/watch?v=d6j6bofhj2M

https://dreamgonfly.github.io/blog/lime/

머신러닝 모델의 블랙박스 속을 들여다보기 : LIME | Dreamgonfly's blog

머신 러닝 모델에 대해서 예측의 이유를 설명하는 것은 어렵습니다. 모델이 복잡해질수록 예측의 정확도는 올라가지만, 결과의 해석은 어려워지죠. 그렇기 때문에 많은 머신 러닝 모델들이 블

dreamgonfly.github.io

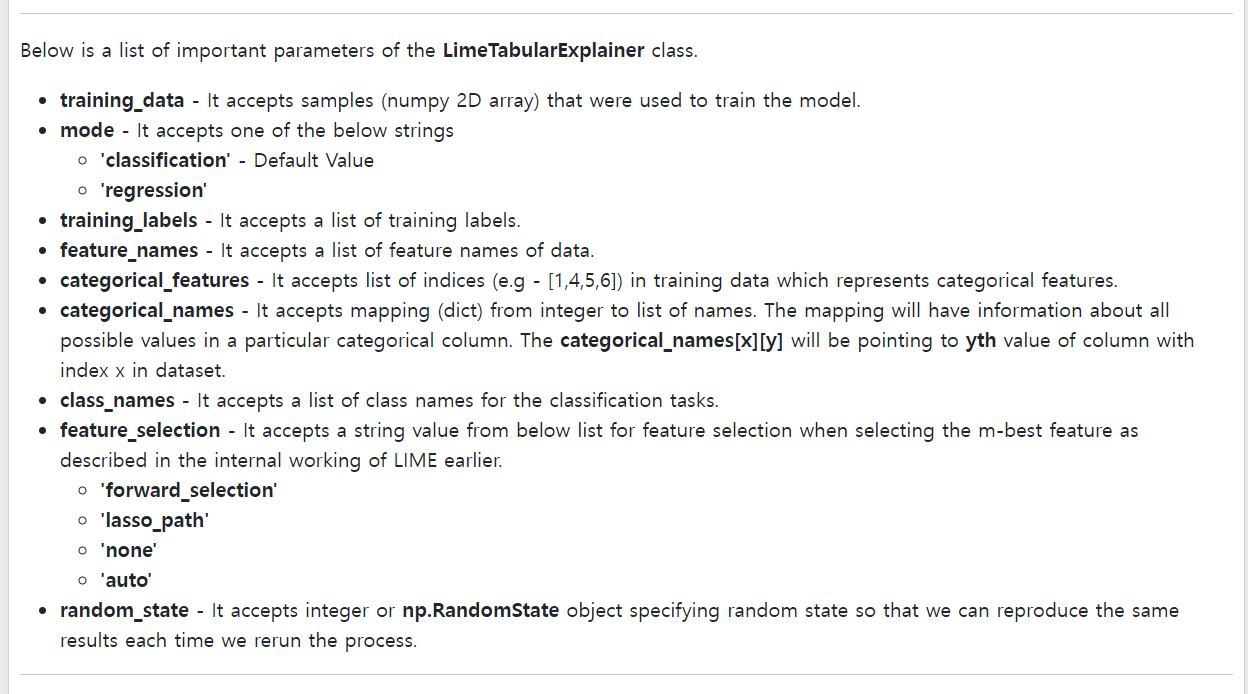

How to Use LIME to Interpret Predictions of ML Models [Python]? by Sunny Solanki

A detailed guide on how to use Python library lime (implements LIME algorithm) to interpret predictions made by Machine Learning (scikit-learn) models. LIME is commonly used to explain black-box as well as white-box ML models. We have explained usage for s

coderzcolumn.com

왜 안될까?

'머신러닝 & 딥러닝' 카테고리의 다른 글

| groupby를 활용하여 상위 k 개 추출 (0) | 2024.02.16 |

|---|---|

| 데이터 불균형 처리(undersampling, oversampling, smote) (0) | 2024.02.05 |

| 데이터 인코딩, 기존에 등록되지 않은 변수가 입력된 경우 (0) | 2024.02.04 |

| [공부기록] 부스팅(Boosting) 모델 간단 리뷰 (AdaBoost, Gradient Boost, XGBoost) (0) | 2023.12.22 |

| MLOps 환경 구축 예시 (0) | 2023.12.13 |